به گزارش خبرگزاری ایمنا، هوش مصنوعی در تعاریف به معنای هوشی ظهور کرده توسط ماشینها است، اما پیش از هر چیز باید این موضوع را دانست که کلمه هوش، نشان دهنده امکان استدلال است و اینکه آیا هوش مصنوعی میتواند به توانایی استدلال دست یابد یا خیر، یکی از اختلافات اصلی محققان است.

کاربردهای هوش مصنوعی گسترده وسیعی دارد، از موتورهای جستوجو پیشرفته و سامانههای توصیهگر تا فهم زبان انسانها و خودروهای خودران و یا رقابت در بالاترین سطوح سامانه بازیهای استراتژیک و مهمتر از همه رباتیک، بخشی کوچک از کاربرد هوش مصنوعی هستند.

لازم به ذکر است هوش مصنوعی (AI) فناوری کاملاً جدید و یا موضوعی ناشناخته نیست و صحبت از آن به دهها سال قبل برمیگردد، اما با گسترش این فناوری در سالیان اخیر سطح نگرانیهای عمومی از خطرات احتمالی نیز گسترش یافت. بررسی خطرات هوش مصنوعی ضرورتی غیرقابل انکار است چرا که هوش مصنوعی با ورود به انواع و اقسام صنایع روزبهروز نقش مهمتری پیدا کردهاست.

با پیشرفت شگفتانگیز هوشمصنوعی، این فناوری میتواند بسیاری از جنبههای زندگی را به طور معجزه آسایی بهبود ببخشد، اما از طرف دیگر نباید خطرات احتمالی آن را نادیده گرفت. برنامهریزی شدن هوش مصنوعی برای انجام کارهای مخرب، اتوماسیون یا خودکارسازی مشاغل و در نهایت افزایش سرانه بیکاری، به خطر افتادن امنیت و حریم خصوصی و سلاحهای خود مختار نگران کننده ترین خطرات هوش مصنوعی است که هشدارهای عمومی را برانگیخته است، اما آیا این خطرات واقعاً وجود دارد؟ اگر وجود دارد راه تقابل با آنها چیست؟

کشتی نجات هوش مصنوعی طوفانی میشود!

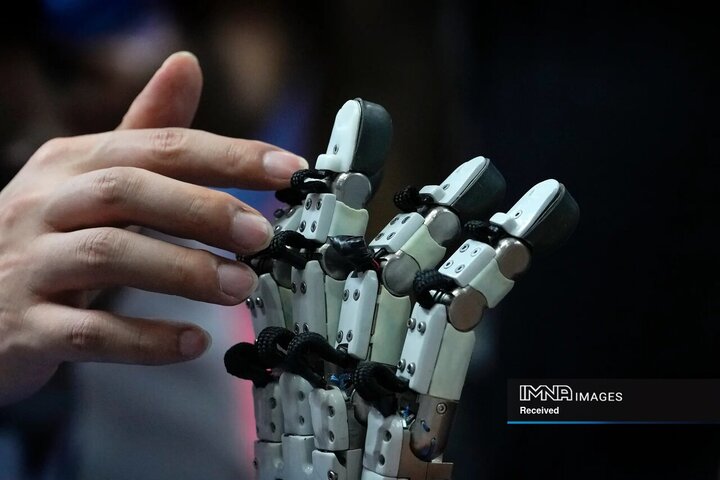

امیر محترمی، عضو هیأت علمی دانشگاه و کارشناس فناوری اطلاعات به خبرنگار ایمنا میگوید: داستان تهدیدات هوشمصنوعی برای تمدن بشری ریشهای چندین ساله دارد به نحوی که این تهدیدات در بسیاری از رمانها و فیلمهای دهه ۶۰ منعکس شده است. تقابل رباتهای هوشمند انساننما با انسان و درنهایت بردگی انسان تصویری است که این اثرات هنری از آینده جهان ترسیم کردند، اما این خواست و هدف هوش مصنوعی نیست.

وی میافزاید: همه تکنولوژیها ترسناک هستند و در ابتدا با مقاومت عموم مواجه میشوند. البته باید در نظر داشت برخی از خطرات احتمالی وهم انگیز هوش مصنوعی، ریشه در واقعیت داشته و باید به فکر چارهای بنیادین برای آن بود، اما این چارهاندیشی باید در جهت کاهش حداکثری مضرات و افزایش منافع فناوری باشد و نباید اجازه داد ترس مانع رشد تکنولوژی شود.

این کارشناس فناوری اطلاعات اظهار میکند: امروزه هوش مصنوعی با ایجاد پدیدههایی که میتوانند بعضاً با معضلات جدی برای جوامع انسانی همراه باشند زنگ خطر را به صدا درآورده است. از سادهترین مسائل مانند به خطر افتادن امنیت اطلاعات و حریم خصوصی افراد گرفته تا تکنولوژی جعل عمیق اسناد و «دیپفیک» خطراتی هستند که میتوانند به راحتی آبروی افراد به ویژه چهرههای ملی کشورها را به بازی بگیرند. جعل عمیق میتواند ساختارهای اعتماد جامعه بشری را کاملاً تخریب کرده و تبعات سیاسی و اجتماعی وسیعی را با خود همراه کند.

وی اذعان میکند: سلاحهای خود مختار از دیگر مسائل نگران کننده در زمینه توسعه هوش مصنوعی است که نظریه ناتوانی در کنترل رباتهای قاتل را بیان میکند. این رباتها از احساسات برخوردار نیستند و این به معنای این است که در مواجه با پدیدههای انسانی طبق دستوری که گرفتهاند عمل میکنند و تصمیمات آنها تحت تأثیر احساسات قرار نمیگیرد.

محترمی تاکید میکند: ایلان ماسک در مصاحبه اخیر خود ادعا کرده است که هوش مصنوعی در آینده انسانها را کاملاً بیکار و در نهایت خانه نشین خواهد کرد که این نیز از دیگر خطرات هوش مصنوعی است، اما نباید فراموش کرد که اساس و بنیان تکنولوژی بر پایه جبران است و اگر بعضی از مشاغل را خالی از وجود بشر میکند در جای دیگری برای انسان جای باز کرده و اشتغال آفرینی خواهد کرد.

وی میافزاید: انسان بدون وقفه در حال حرکت است و هوش مصنوعی نمیتواند از این حرکت جلوگیری کند، توسعه تکنولوژی صرفاً به معنای کاهش فعالیتهای فیزیکی و بازو محور انسان و افزایش فعالیتهای ذهنی، مفهومی و حتی تفریحی است به همین جهت نمیتوان آینده هوش مصنوعی را به صورت قاتلی برای اشتغال انسان به تصویر کشید.

این عضو هیئت علمی دانشگاه در پایان متذکر میشود: نقش اول تصورات نگران کننده از آینده بشر، خطراتی هستند که در زمان وقوع چاره آنها قابل اندیشیدن است به علاوه بشر هیچگاه به استثمار هوش مصنوعی در نخواهد آمد چراکه سیستمهای کنترلگر رباتها نیز به موازات رشد و شکلگیری ماشینهای انسان نما پیشرفت خواهند کرد؛ لازم به ذکر است امروزه نیز در سازمان ملل و مجامع عمومی وضع قوانین متعدد در راستای هوش مصنوعی و محدودیت دسترسیها با هدف جلوگیری از عواقب اخلاقی این تکنولوژی مورد بحث قرار گرفته است.

ترس از خطر خود یک خطر است

به گزارش ایمنا، با پیشرفت هوش مصنوعی، کاربردهای این فناوری نیز بیشتر خواهد شد، اما متأسفانه یک تکنولوژی جدید قدرتمند همواره در معرض خطر سوء استفاده قرار دارد. خطراتی که میتوانند تمام جنبههای زندگی روزمره ما را تحت تأثیر قرار دهند، از حریم خصوصی و امنیت سیاسی گرفته تا اتوماسیون شغلها با این حال نباید اجازه داد ترس بیش از اندازه از این خطرات مانع پیشرفت فناوریها شود.

ترس زمانی خوب است که دقت و کیفیت کار را افزایش دهد، اما اگر تبدیل به عاملی بازدارنده شود نه تنها کمکی به دفع خطرات نکرده بلکه خود نیز تبدیل به خطری بزرگ خواهد شد. توجه به خطرات هوش مصنوعی و یافتن راهی جهت مقابله با آنها در کنار گسترش این فناوری ضروری، مهم و غیر قابل انکار است و باید جدی گرفته شود.

نظر شما